Practice Test #3

50개 문제와 100분 시간 제한으로 실제 시험을 시뮬레이션하세요. AI 검증 답안과 상세 해설로 학습하세요.

AI 기반

3중 AI 검증 답안 및 해설

모든 답안은 3개의 최고 AI 모델로 교차 검증하여 최고의 정확도를 보장합니다. 선택지별 상세 해설과 심층 문제 분석을 제공합니다.

기출 문제

VM1이라는 가상 머신이 포함된 Azure 구독이 있습니다. VM1은 하루 24시간 사용 가능한 기간 업무(line-of-business) 애플리케이션을 호스팅합니다. VM1에는 네트워크 인터페이스 1개와 managed disk 1개가 있습니다. VM1은 D4s v3 크기를 사용합니다. VM1에 대해 다음 변경을 계획하고 있습니다: ✑ 크기를 D8s v3로 변경합니다. ✑ 500-GB managed disk를 추가합니다. ✑ Puppet Agent extension을 추가합니다. ✑ Desired State Configuration Management를 사용하도록 설정합니다. 어떤 변경이 VM1에 다운타임을 발생시키나요?

참고: 이 질문은 동일한 시나리오를 제시하는 일련의 질문 중 일부입니다. 이 시리즈의 각 질문에는 명시된 목표를 충족할 수도 있는 고유한 솔루션이 포함되어 있습니다. 일부 질문 세트에는 정답이 둘 이상 있을 수 있으며, 다른 세트에는 정답이 없을 수도 있습니다. 이 섹션에서 질문에 답한 후에는 해당 질문으로 돌아갈 수 없습니다. 따라서 이러한 질문은 검토 화면에 표시되지 않습니다. Adatum이라는 Azure Directory (Azure AD) 테넌트와 Subscription1이라는 Azure Subscription이 있습니다. Adatum에는 Developers라는 그룹이 포함되어 있습니다. Subscription1에는 Dev라는 리소스 그룹이 포함되어 있습니다. Developers 그룹에 Dev 리소스 그룹에서 Azure logic apps를 만들 수 있는 권한을 제공해야 합니다. 솔루션: Subscription1에서 Developers 그룹에 DevTest Labs User 역할을 할당합니다. 이것이 목표를 충족합니까?

참고: 이 질문은 동일한 시나리오를 제시하는 일련의 질문 중 일부입니다. 이 시리즈의 각 질문에는 명시된 목표를 충족할 수 있는 고유한 솔루션이 포함되어 있습니다. 일부 질문 세트에는 정답이 둘 이상 있을 수 있으며, 다른 세트에는 정답이 없을 수도 있습니다. 이 섹션의 질문에 답한 후에는 해당 질문으로 돌아갈 수 없습니다. 따라서 이러한 질문은 검토 화면에 표시되지 않습니다. Windows Server 2016을 실행하는 VM1이라는 Azure virtual machine이 있습니다. 1시간 이내에 VM1의 System event log에 두 개를 초과하는 error event가 기록될 때 Azure에서 alert를 생성해야 합니다. 솔루션: Azure Log Analytics workspace를 만들고 data settings를 구성합니다. VM1에 Microsoft Monitoring Agent를 설치합니다. Azure Monitor에서 alert를 만들고 source로 Log Analytics workspace를 지정합니다. 이 목표를 충족합니까?

참고: 이 문제는 동일한 시나리오를 제시하는 일련의 문제 중 일부입니다. 이 시리즈의 각 문제에는 제시된 목표를 충족할 수도 있는 고유한 솔루션이 포함되어 있습니다. 일부 문제 세트에는 정답이 둘 이상 있을 수 있으며, 다른 문제 세트에는 정답이 없을 수도 있습니다. 이 섹션의 문제에 답한 후에는 해당 문제로 돌아갈 수 없습니다. 따라서 이러한 문제는 검토 화면에 표시되지 않습니다. Windows Server 2016을 실행하는 VM1이라는 Azure virtual machine이 있습니다. 1시간 이내에 VM1의 System event log에 두 개를 초과하는 error event가 기록될 때 Azure에서 alert를 생성해야 합니다. 솔루션: Azure Log Analytics workspace를 만들고 data settings를 구성합니다. VM1에 Microsoft Monitoring Agent VM extension을 추가합니다. Azure Monitor에서 alert를 만들고 Log Analytics workspace를 source로 지정합니다. 이것이 목표를 충족합니까?

HOTSPOT - 가상 네트워크 서브넷에 가상 머신 5대를 배포할 계획입니다. 각 가상 머신에는 public IP address와 private IP address가 각각 하나씩 있습니다. 각 가상 머신에는 동일한 inbound 및 outbound 보안 규칙이 필요합니다. 필요한 network interface 및 network security group의 최소 개수는 얼마입니까? 답하려면, 답안 영역에서 적절한 옵션을 선택하십시오. 참고: 각 정답 선택은 1점입니다. Hot Area:

네트워크 인터페이스의 최소 개수: ______

네트워크 security group의 최소 개수: ______

이동 중에도 모든 문제를 풀고 싶으신가요?

Cloud Pass를 다운로드하세요 — 모의고사, 학습 진도 추적 등을 제공합니다.

다음 위치에 데이터가 포함된 Azure subscription이 있습니다: Name Type container1 Blob container share1 Azure files share DB1 SQL database Table1 Azure Table Export1이라는 Azure import/export job을 사용하여 데이터를 내보낼 계획입니다. Export1을 사용하여 내보낼 수 있는 데이터를 식별해야 합니다. 어떤 데이터를 식별해야 합니까?

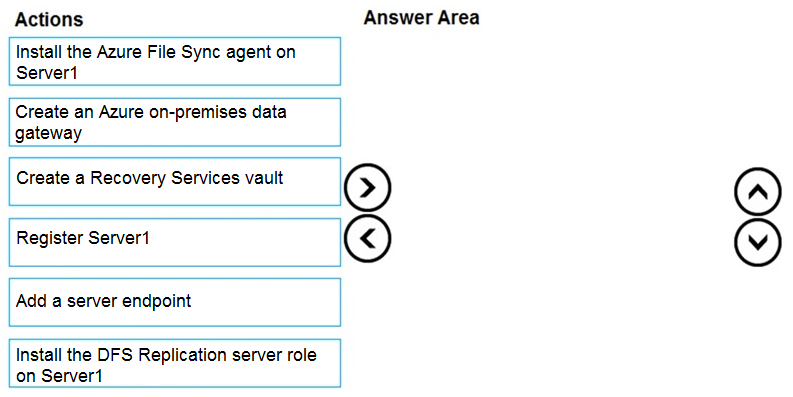

DRAG DROP - Windows Server 2016을 실행하는 Server1이라는 온-프레미스 파일 서버가 있습니다. Azure file share가 포함된 Azure 구독이 있습니다. Azure File Sync Storage Sync Service를 배포하고 sync group을 생성합니다. Server1에서 Azure로 파일을 동기화해야 합니다. 다음 중 어떤 세 가지 작업을 순서대로 수행해야 합니까? 답하려면 작업 목록에서 적절한 작업을 답안 영역으로 이동하고 올바른 순서로 정렬하십시오. Select and Place:

아래 이미지에서 올바른 답(들)을 선택하세요.

Subscription1이라는 Azure 구독이 있습니다. Subscription1으로 전송해야 하는 5 TB의 데이터가 있습니다. Azure Import/Export job을 사용할 계획입니다. 가져온 데이터의 대상으로 무엇을 사용할 수 있습니까?

Azure 가상 머신을 배포하는 데 사용되는 Template1이라는 Azure Resource Manager 템플릿이 있습니다. Template1에는 다음 텍스트가 포함되어 있습니다:

"location": {

"type": "String",

"defaultValue": "eastus",

"allowedValues": [

"canadacentral",

"eastus",

"westeurope",

"westus" ]

}

Template1의 variables 섹션에는 다음 텍스트가 포함되어 있습니다: "location": "westeurope" Template1의 resources 섹션에는 다음 텍스트가 포함되어 있습니다:

"type": "Microsoft.Compute/virtualMachines",

"apiVersion": "2018-10-01",

"name": "[variables('vmName')]",

"location": "westeurope",

Template1을 사용하여 가상 머신을 West US 위치에 배포해야 합니다. 무엇을 해야 합니까?

HOTSPOT - Azure Active Directory (Azure AD)의 하이브리드 배포가 있으며, 다음 표에 표시된 사용자가 포함되어 있습니다. 이름 | 유형 | 원본 User1 | Member | Azure AD User2 | Member | Windows Server Active Directory User3 | Guest | Microsoft account 사용자의 JobTitle 및 UsageLocation 특성을 수정해야 합니다. 어떤 사용자에 대해 Azure AD에서 해당 특성을 수정할 수 있습니까? 답하려면 답안 영역에서 적절한 옵션을 선택하십시오. 참고: 각 정답 선택은 1점입니다. 핫 영역:

JobTitle: ______

UsageLocation: ______

다른 모의고사

Practice Test #1

Practice Test #2

Practice Test #4

Practice Test #5

Practice Test #6

Practice Test #7

Practice Test #8

Practice Test #9

앱 받기